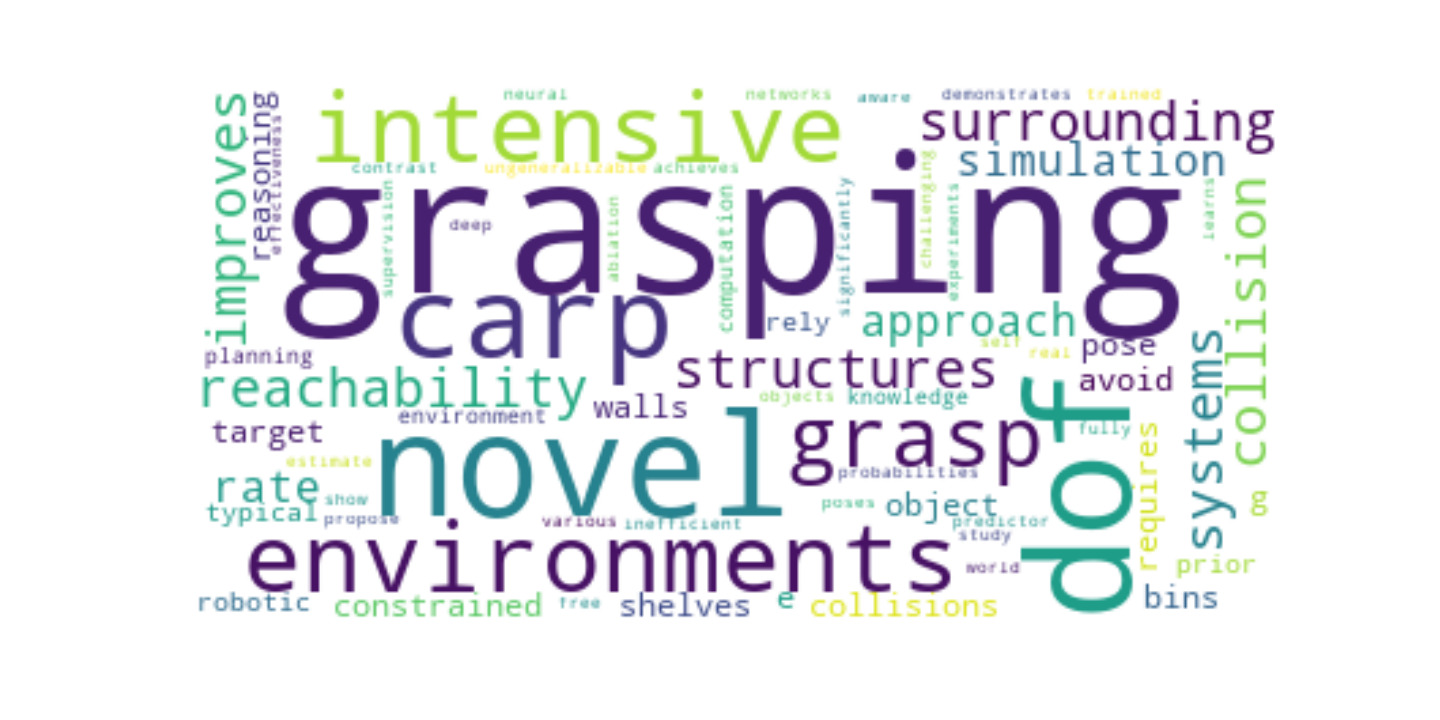

今回は、"Collision-Aware Target-Driven Object Grasping in Constrained Environments"という論文について紹介していきます!

論文情報

著者 : Xibai Lou, Yang Yang, Changhyun Choi

(Submitted on 1 Apr 2021)

ひとこと紹介

6自由度のものをつかむロボットアームシステムのために、Collision-Aware Reachability Predictor (CARP)を提案!

イントロダクション

ターゲット駆動で物をつかむタスク

ターゲット駆動型で物をつかむことは、ロボット操作では基本的ではありつつも難しいタスクの一つである。理由としては、部分的にしか把握しきれていないにもかかわらず、つかむために必要な安定性などを考慮しなければいけないことがあげられる。

そこで多くのシステムでは、テーブルの上でのタスクを想定し3DoFでつかむ動作をすることで、推論の困難さを軽減している。

しかし、制約のある環境で未知のターゲットをつかむためには、自律型ロボットの行動空間を3-DoFから6-DoFに拡張する必要がある。

また、これらの環境では2つの課題を考える必要が出てくる。

1)未知のターゲットや周辺構造物をいかにロバストに認識できるか?

2)周辺構造物が「つかめるか否か」の成功確率に与える影響をいかに予見できるか?

Degree of Freedom の略で 自由度 を表す

target-driven(ターゲット駆動型) grasping pipeline

最近では、既存の物体認識モジュール(検出器,テンプレートマッチング,分類器など)とデータ駆動型のつかむモデルを組み合わせた、アプローチが提案されている。

ただこれらのアプローチは、物体を中心としたつかむ動作の推論に焦点を当てており、物体以外のscene context を見落としているといえる。

その結果、周囲に構造物(壁やビンなど)があるような制約つきの環境では,膨大な数のつかむポーズをサンプリングし、その中から衝突チェックアルゴリズムを用いて繰り返し探索する必要がある。

さらに、これらのアプローチは、環境に関する完全なknowledge(例えば、周囲の構造物の幾何学的モデル)を必要とするが、実際には、部分的にしか観測することができない。

したがって、衝突認識がないために、多くの計画失敗に悩まされることになる。

また、これらのアプローチのもう一つの限界は、知覚にある。

シミュレーションは、開発とトレーニングを迅速に行うことができる。

ただ、RGB画像に基づく物体認識モジュールは

- シミュレーションと実物のギャップを埋めるために追加の処理が必要

- 未知の物体への一般化も不十分

このような問題を解決するために、この研究では"target-driven(ターゲット駆動型) grasping pipeline"を開発している。このパイプラインでは,未知のオブジェクトのsingle-shot認識を実現し,制約のある環境で6DoFのつかむ動作を行うための single planning のみを必要とする.

提案手法

提案されている衝突を考慮したパイプラインはロバストな認知モジュールと衝突を考慮した6DoFのつかむ動作を行うモジュールを統合したものである。

認知モジュールは、Siamese networksを用いたシミュレーションで奥行き情報を利用し、シングルショットの認識とシミュレーションによる一般化を行う。

6DoF graspingモジュールには,Collision-Aware Reachability Predictor (CARP) が搭載されています。CARPは3次元畳み込みニューラルネットワーク(3D CNN)で、ロボットマニピュレータと周囲の構造物が衝突することなく一連のつかむ動作ができる確率を明示的に学習します。

衝突しない確率と、3D CNNベースのGrasp Stability Predictor (GSP)によるつかむ動作の安定性予測を組み合わせることで、6DoF grasping ポーズの全体的な実現可能性を評価する。

Contributions

この研究は、制約のある環境下での衝突を明示的に推定し、ターゲット駆動な6DoFのつかむ動作を実現する初期の試みである。

また、この研究で行われている主なContributionは以下の通りである。

- 衝突を考慮した到達可能性予測(Collision-Aware Reachability Predictor: CARP)は、空間情報と6DoFのつかむ動作の無衝突確率の相関関係を3D CNNでモデル化したものです。CARPは、合成された奥行きデータを用いて自己教師として学習され、実世界に直接転送されます。

- ターゲット駆動型のロボットがつかむ動作のパイプラインは,奥行きベースのSingle shot 認識モジュール,Collision-Aware Reachability Predictor,およびGrasp Stability Predictorで構成されています.このパイプラインは、クラッタの中にある新規のターゲットオブジェクトを特定し、制約のある環境下でsingle planningでつかむことができる。

この論文の構成

- Introduction

- 関連研究

- Problem Formulation

- 提案手法

- Experiments

- Conclusion

コメント